Parece que los temores de los defensores de la privacidad y la protección de datos con respecto a los dispositivos de voz se han hecho realidad; al menos en un solo caso en el que Amazon filtró los datos de voz de un cliente a otro cliente.

Qué pasó? Según (PDF) de la revista informática alemana CT, uno de los clientes alemanes de Amazon solicitó acceso a los datos que la empresa había almacenado sobre él. Amazon envió al cliente un archivo zip con los datos y el cliente comenzó a analizarlo.

Notó que el archivo incluía alrededor de 1700 archivos WAV y un documento PDF que contenía transcripciones de Alexa. El cliente no poseía ni usaba dispositivos Alexa y rápidamente concluyó, después de reproducir algunos archivos de audio, que las grabaciones no eran suyas.

El cliente se puso en contacto con Amazon sobre el incidente, pero no salió nada; decidió ponerse en contacto con CT y le proporcionó a CT una muestra de los archivos. Las grabaciones de audio proporcionaron una gran cantidad de información sobre el entonces desconocido cliente de Amazon, incluido dónde y cómo se usó Alexa, información sobre trabajos, personas, alarmas, me gusta, controles de aplicaciones domésticas y consultas de transporte.

CT creó un perfil del usuario y pudo identificar al cliente, su novia y algunos amigos, usándolo. CT contactó al cliente y este confirmó que su voz estaba en las grabaciones.

Amazon le dijo a la revista que la filtración "fue un desafortunado percance que fue resultado de un error humano". Amazon se puso en contacto con ambos clientes después de que CT se puso en contacto con la empresa.

Asuntos de privacidad

Amazon almacena los datos de voz de Alexa de forma indefinida en la nube. La empresa lo hace para "mejorar sus servicios". Los datos pueden usarse para identificar a los propietarios de los dispositivos Alexa y otros mencionados en las grabaciones o audibles cuando se realizan las grabaciones. Si bien depende de cómo se usen los dispositivos Alexa, está claro que las grabaciones contienen información privada con la que la mayoría, si no todos, los clientes se sentirían muy incómodos si se filtraran a otros.

La mayoría de los propietarios de dispositivos controlados por voz probablemente desconozcan, o sean indiferentes, que sus datos se almacenan en la nube de forma indefinida.

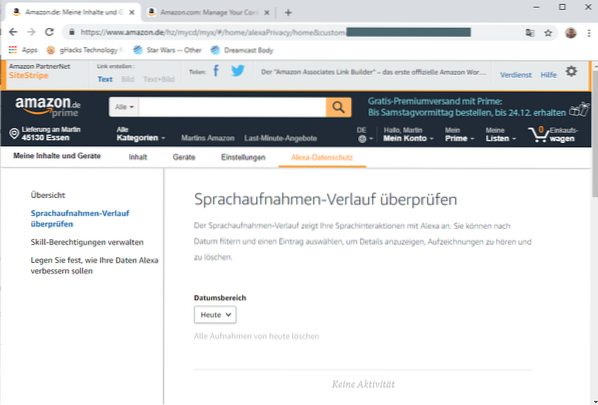

Los clientes de Amazon pueden eliminar las grabaciones de voz que Amazon ha almacenado en la nube en https: // amazon.de / alexaprivacy /. No pude acceder a la funcionalidad en el sitio web principal de Amazon, https: // amazon.com / alexaprivacy /, ya que redirigió la solicitud automáticamente.

La página en alemán es accesible y ofrece opciones para eliminar grabaciones que Amazon tiene archivadas. Sin embargo, no hay opción para evitar que Amazon almacene grabaciones en primer lugar. No está claro si la página funciona solo para clientes alemanes o para todos los clientes de Amazon.

Palabras de cierre

Las empresas deben tener en cuenta los errores humanos cuando se trata de filtraciones y violaciones de la privacidad. El caso de Amazon demuestra que las fugas pueden ocurrir por numerosas razones, incluidos intentos de piratería, errores de software o errores humanos.

Ahora tu: ¿Usas dispositivos controlados por voz??

Phenquestions

Phenquestions